Subtitulo: Um guia pratico para sair do texto livre, validar respostas do modelo com esquemas claros e reduzir retrabalho em automacoes Python com IA.

Durante muito tempo, integrar LLMs em Python significou pedir uma resposta em JSON, torcer para ela vir no formato esperado e depois montar uma camada de remendos para limpar aspas, chaves quebradas e campos fora do padrao. Isso funciona em demos, mas degrada rapido quando o fluxo passa a alimentar automacoes, dashboards, pipelines de atendimento ou tarefas internas que precisam de consistencia.

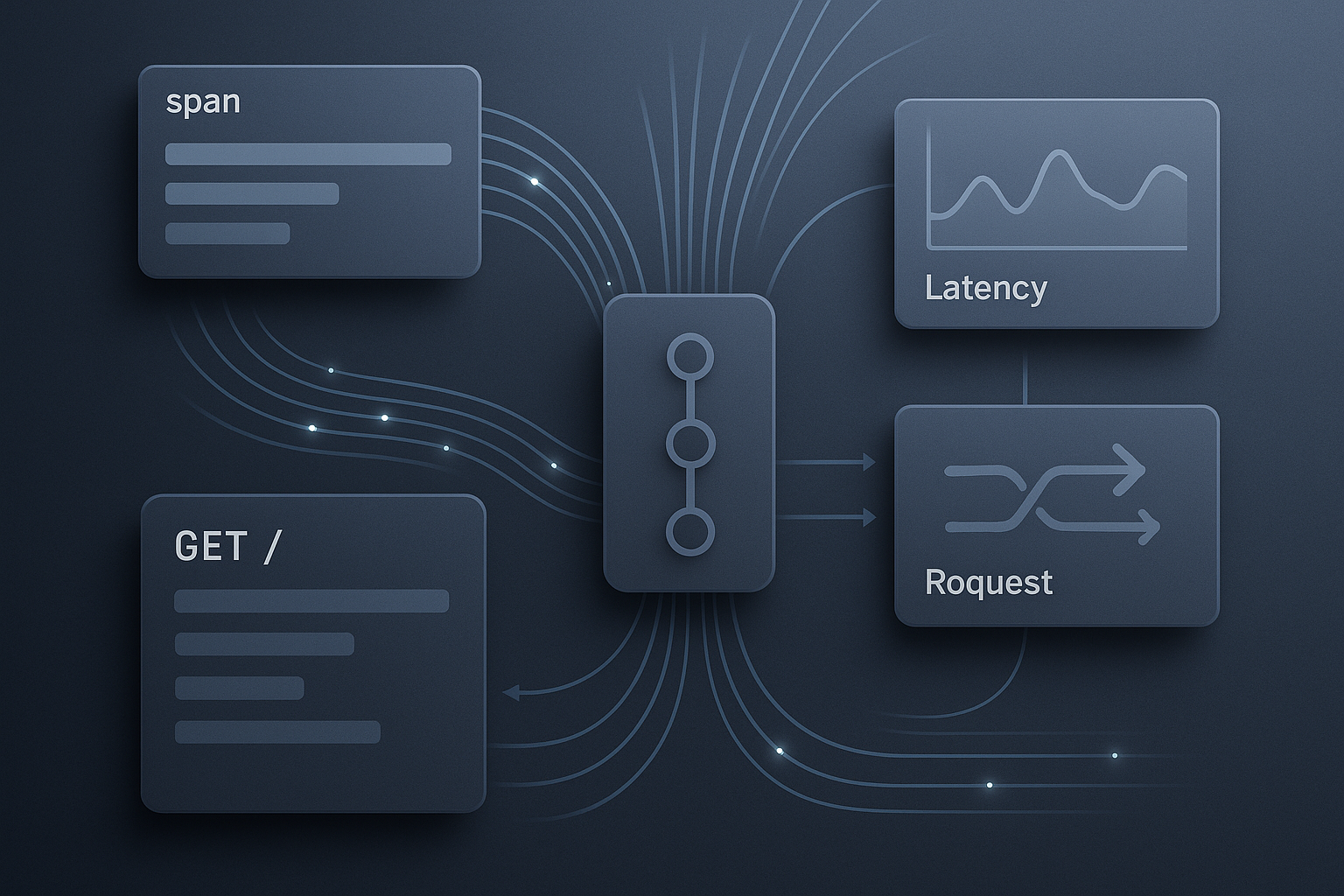

O movimento mais importante dos ultimos ciclos de ferramentas para IA aplicada em Python foi justamente abandonar esse parsing fragil em favor de contratos estruturados. Na pratica, voce descreve o formato esperado, valida a resposta e transforma a saida do modelo em um objeto previsivel para o restante da aplicacao. Isso reduz ambiguidade, facilita teste, melhora observabilidade e deixa a manutencao muito menos cara.

Neste artigo, vamos ver como pensar esse padrao com Pydantic, onde ele entrega valor real, quais limites continuam existindo e como implementar um fluxo simples e robusto para producao.

Por que saidas estruturadas viraram prioridade

Quando o modelo devolve texto livre, a aplicacao precisa interpretar o que veio. Esse processo costuma quebrar por tres motivos: variacao no formato, campos ausentes e mistura entre resposta final e metadados. Em um script pequeno isso gera ruido. Em producao, gera incidente.

Com contratos estruturados, o papel do modelo muda. Em vez de responder de qualquer jeito, ele precisa preencher um formato definido previamente. O SDK e a camada de validacao ficam responsaveis por transformar essa resposta em tipos confiaveis. Esse desenho traz quatro ganhos diretos:

- Menos parsing manual: menos regex, menos heuristica e menos codigo de limpeza.

- Erros detectados mais cedo: se um campo estiver ausente ou incompativel, a validacao falha de forma explicita.

- Melhor integracao com Python: o restante do sistema trabalha com objetos tipados, nao com dicionarios improvisados.

- Maior previsibilidade operacional: logs, testes e retries ficam mais simples de interpretar.

Esse padrao importa especialmente em tarefas como extracao de dados, classificacao de tickets, enriquecimento de CRM, analise de documentos, geracao de tarefas operacionais e composicao de payloads para outras APIs.

O papel do Pydantic nesse fluxo

Pydantic nao e apenas uma biblioteca de validacao. Em um stack de Python com IA, ele funciona como a camada que traduz a intencao do negocio para um contrato executavel. Voce declara os campos, os tipos, as restricoes e, quando necessario, regras extras. O resultado e um modelo que documenta a estrutura esperada e tambem protege a aplicacao contra respostas inconsistentes.

Isso cria um efeito importante: o prompt deixa de carregar sozinho a responsabilidade pela qualidade da saida. Em vez de escrever um texto longo dizendo para o modelo sempre retornar uma lista com certos campos, voce combina uma instrucao clara com uma estrutura verificavel. O prompt continua importante, mas deixa de ser o unico mecanismo de controle.

Exemplo mental simples

Imagine um fluxo que recebe mensagens de clientes e precisa gerar uma triagem automatica. Se o modelo devolver apenas texto, sua automacao precisa descobrir onde esta a prioridade, o sentimento, o resumo e o proximo passo. Com um modelo Pydantic, voce pode exigir campos como prioridade, resumo, acao_recomendada e confianca. A partir dai, qualquer etapa posterior passa a operar sobre dados previsiveis.

Como desenhar um fluxo minimo e robusto

1. Modele a saida com foco operacional

O primeiro erro comum e criar esquemas grandes demais. Em vez disso, defina apenas o que a aplicacao realmente usa. Se um campo nao muda nenhuma decisao, talvez ele nem precise existir. Esquemas enxutos sao mais faceis de validar, monitorar e versionar.

Uma boa regra pratica e separar:

- Campos obrigatorios para a automacao seguir.

- Campos opcionais que agregam contexto.

- Campos que podem ser derivados depois, sem gastar tokens do modelo.

2. Use tipos e restricoes a seu favor

Pydantic permite expressar mais do que strings e inteiros. Voce pode limitar enumeracoes, impor intervalos, validar listas e organizar objetos aninhados. Isso reduz o espaco para respostas vagas. Se a sua aplicacao trabalha com severidades como baixa, media e alta, trate isso como contrato, nao como convencao informal no prompt.

3. Diferencie falha de validacao e falha de negocio

Nem todo erro deve disparar o mesmo tratamento. Se a resposta nao atende ao esquema, o problema e estrutural: vale retry, ajuste de instrucao ou fallback. Se a resposta atende ao esquema, mas a confianca esta baixa ou o conteudo nao permite decisao segura, o problema e de negocio: talvez seja caso de revisao humana. Essa separacao ajuda muito no desenho de observabilidade e SLA.

4. Registre a versao do contrato

Quando a saida estruturada passa a alimentar outros sistemas, mudar nomes de campos ou formatos sem controle vira fonte de regressao. Inclua versionamento no proprio pipeline, nem que seja em metadados internos. Essa disciplina simplifica rollout, testes A-B e reversao.

Um exemplo pratico em Python

Considere um caso de extracao de leads a partir de formularios longos ou transcricoes de contato comercial. Em vez de pedir um resumo solto, voce pode definir uma estrutura como esta:

from pydantic import BaseModel, Field

from typing import Literal

class LeadQualificado(BaseModel):

nome_empresa: str = Field(min_length=2)

segmento: str

prioridade: Literal["baixa", "media", "alta"]

desafio_principal: str

proximo_passo: str

confianca: float = Field(ge=0, le=1)

Com esse desenho, a integracao deixa de perguntar apenas “o que o modelo entendeu?” e passa a perguntar “a resposta serve para a operacao continuar com seguranca?”. Essa e a mudanca que realmente importa em produto.

Na implementacao, o fluxo recomendado e:

- Enviar a entrada com instrucao objetiva sobre a tarefa.

- Solicitar resposta estruturada alinhada ao modelo definido.

- Validar o retorno imediatamente.

- Tratar recusas, campos invalidos e baixa confianca por caminhos separados.

- Persistir apenas o objeto validado ou encaminhar para revisao.

Perceba que o ganho nao esta apenas em “receber JSON”. O ganho real e reduzir a area cinzenta entre a geracao do modelo e a logica do sistema.

Onde esse padrao entrega mais valor

Extracao de dados

Contratos estruturados funcionam muito bem para notas de reuniao, curriculos, tickets, documentos juridicos, formularios e respostas abertas. O principal beneficio e diminuir a quantidade de tratamento especial por caso.

Roteamento e classificacao

Quando o modelo precisa escolher categoria, prioridade, area responsavel ou acao recomendada, esquemas tipados evitam que a classificacao venha em formatos diferentes a cada chamada.

Automacoes entre sistemas

Se a resposta do modelo vai virar payload para CRM, ERP, help desk ou webhook interno, a validacao antes do envio reduz erro cascata. Em vez de descobrir o problema na terceira integracao da cadeia, voce interrompe cedo e com contexto.

Limites que continuam existindo

Saida estruturada nao transforma o modelo em banco de dados nem elimina a necessidade de julgamento de negocio. Ha pelo menos quatro limites importantes:

- Esquema correto nao garante conteudo correto: o formato pode estar valido e a analise ainda assim ser ruim.

- Campos demais pioram a confiabilidade: quanto maior o contrato, maior a chance de friccao e custo.

- Validacao nao substitui regras de dominio: aceitar um numero de 0 a 1 nao significa que a confianca faz sentido para o caso.

- Streaming e UX em tempo real exigem desenho extra: nem todo fluxo estruturado combina com a mesma experiencia de resposta incremental.

Em outras palavras, use contratos para reduzir ambiguidade tecnica, nao para esconder decisoes de produto que ainda precisam ser explicitas.

Checklist para adotar sem criar uma arquitetura pesada

- Comece com um caso de uso em que o resultado ja vira acao automatizada.

- Modele o menor conjunto de campos que desbloqueia a operacao.

- Use Pydantic para tipos, limites e enums em vez de empurrar tudo para o prompt.

- Separe logs de falha estrutural, recusa do modelo e revisao humana.

- Teste entradas boas, ambiguas e incompletas antes de ampliar o fluxo.

- Versione o contrato quando a resposta alimentar mais de um consumidor.

O que aplicar agora no seu projeto

Se voce hoje ainda depende de respostas livres em Python e depois faz limpeza manual para montar objetos, o proximo passo mais valioso nao e escrever prompts mais longos. E introduzir um contrato simples, validar cedo e medir quantas excecoes somem desse pipeline. Em muitos projetos, essa mudanca reduz tanto o retrabalho quanto o medo de colocar a automacao em producao.

Para times que constroem produtos, automacoes e operacoes assistidas por IA, o ganho e menos glamour e mais previsibilidade. E exatamente isso que separa um experimento promissor de um fluxo que o negocio consegue manter.

Se a sua equipe quer transformar prototipos de IA em processos confiaveis, a Devcraftstudio pode ajudar a desenhar contratos, observabilidade e automacoes que funcionem no mundo real.

Fontes de pesquisa

- OpenAI, Introducing Structured Outputs in the API

- OpenAI Python SDK

- Pydantic Documentation, JSON